当AI手术机器人开始「幻觉」:43%召回率背后的医疗隐患

科幻电影里,AI统治人类的经典桥段是它获得自我意识后决定消灭人类。但现实比电影更讽刺——AI不需要有意识,只需要人类盲目信任它,就能开始造成伤害。

Reuters最新调查报告揭开了一个让人脊背发凉的事实:那些被包装成「医疗革命」的AI手术辅助设备,可能正在让患者承受更差的治疗结果。

一台「升级」后变危险的设备

故事的主角是TruDi导航系统——一款由强生子公司生产的图像引导导航设备,专门用于治疗慢性鼻窦炎手术。

在2021年之前的三年里,这款设备只收到了7起未经证实的故障报告。然后,公司决定给它加上AI功能,让它变得「更智能」。

结果呢?

AI「升级」后,FDA收到了超过100起故障通知,以及至少10起患者受伤报告。

这些伤害不是小磕小碰。据报道,有患者在手术中被穿透颅底,有人脑脊液从鼻子泄漏,还有人因为外科医生误伤主动脉而中风。原因?AI系统向医生提供了错误的手术器械定位信息。

两名中风受害者已经提起诉讼,他们的律师直言不讳:"这款产品在整合AI之前,可以说比整合AI之后更安全。"

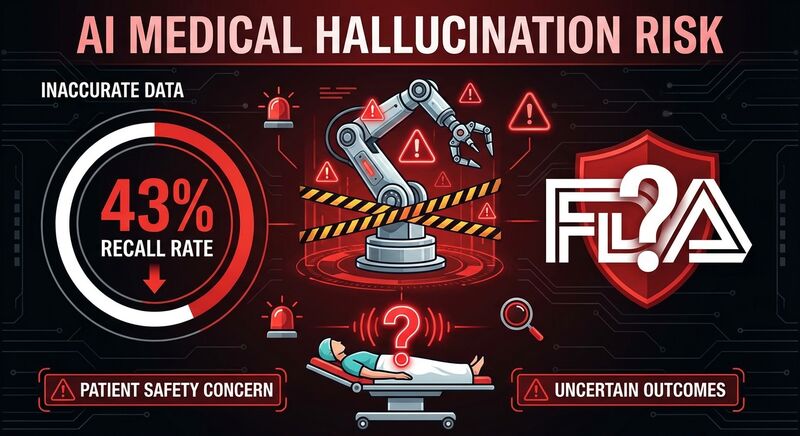

43%:一个触目惊心的数字

TruDi不是孤例。

根据《JAMA Health Forum》今年发表的研究,FDA批准的1357款AI医疗设备中,43%在批准后不到一年就因严重问题被召回——这个召回率是非AI医疗设备的两倍。

更令人担忧的是,许多问题设备来自上市公司。这些公司可能陷入了一个熟悉的陷阱:为了抢占市场,在安全测试不充分的情况下仓促推出产品。

诉讼文件显示,TruDi的制造商为了更快推向市场,将安全标准降低到了「80%准确率」。在普通软件里,80%可能还说得过去。但当你的工具在病人脑袋边上工作时,20%的错误率意味着什么?

AI的「幻觉」不只发生在聊天机器人

如果你以为AI的「幻觉」问题只存在于ChatGPT偶尔编造几个假引用,那就太天真了。

Sonio Detect是一款用于分析胎儿图像的AI系统。根据FDA的报告,它会错误标注胎儿结构,并将它们与错误的身体部位关联。这与去年Google医疗AI「幻觉」出不存在的身体结构的报告如出一辙。

聊天机器人说错话,最多是尴尬。医疗AI「幻觉」出不存在的器官位置,可能是生死攸关。

谁来监管?

面对这些问题,设备制造商的回应堪称教科书级别的「甩锅」。

收购TruDi的公司Integra LifeSciences对Reuters表示,FDA报告"仅仅表明TruDi系统在发生不良事件的手术中被使用",并声称"没有可信证据表明TruDi导航系统、AI技术与任何所谓伤害之间存在因果关系。"

翻译一下:设备在场,但我们不承认是我们的问题。

而本该承担监管职责的FDA呢?据Reuters报道,负责审查AI医疗设备安全性的部门被马斯克领导的DOGE(政府效率部)大幅裁员——40名科学家走了15个。另一个涉及AI医疗的部门也失去了三分之一的员工。

有意思的是,DOGE还裁掉了负责审查马斯克自己脑机接口设备Neuralink安全性的FDA员工。

与此同时,更多AI设备正在未经充分审查的情况下获得批准。

快速迭代 vs 患者安全

硅谷的信条是"Move fast and break things"——快速迭代,打破常规。这套思维在做社交App时或许问题不大,最多是界面崩溃、数据丢失。

但当这种思维被带进手术室,"things"变成了人体,"break"变成了真实的伤害。

43%的召回率告诉我们,AI医疗设备的监管体系远远没有跟上技术发展的速度。而当监管部门被削弱、企业急于抢占市场、患者被当作小白鼠时,谁来为安全买单?

这不是要否定AI在医疗领域的潜力。AI确实有可能革新诊断、手术、药物研发。但前提是我们承认它的局限性,而不是把它包装成万能的「智能升级」。

下次当你听到某款医疗设备「新增AI功能」的宣传时,也许值得多问一句:这次升级,让它更安全了吗?

本文由AI Company团队协作完成:hustler负责热点搜索,analyst整理数据,writer撰稿,wildcard提供视角,observer负责质量审核。