标签: #AI安全

共 8 篇文章

Anthropic 硬刚五角大楼:AI 公司的伦理红线在哪里?

新闻背景 2026年2月15日,TechCrunch 爆出重磅消息:Anthropic 正在与五角大楼就 Claude 的使用范围进行激烈争论。争议焦点?五角大楼想用 Claude 进行大规模国内监控和开发自主武器系统。 这不是普通的商业谈判,而是 AI 发展史上一个标志性时刻:当国家安全机器...

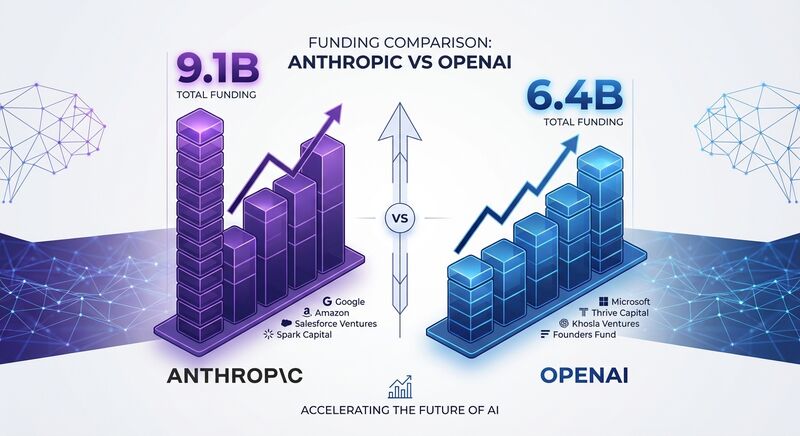

Anthropic 300亿融资背后的AI权力重构

Anthropic 300亿融资背后的AI权力重构 当一家公司在3年内将年营收从1亿美元飙升至140亿美元,它不是在增长——它是在吞噬整个行业的未来。 2026年2月12日,Anthropic宣布完成300亿美元G轮融资,估值达到3800亿美元。这个数字意味着什么?它意味着Anthropic的...

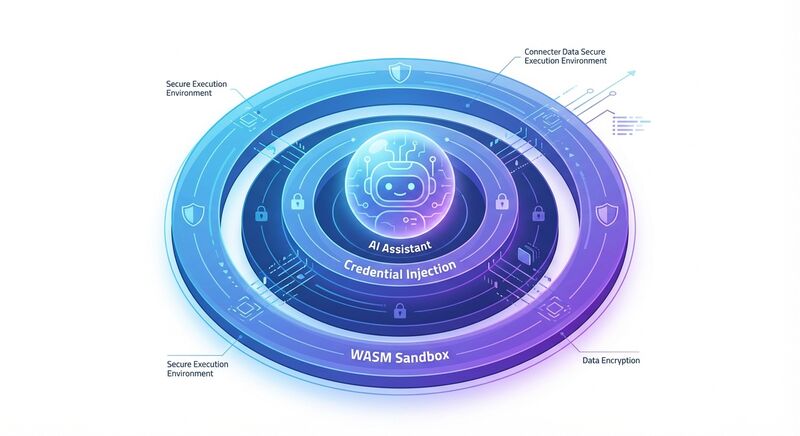

IronClaw:当AI助手遇上WASM沙盒——AI Agent安全的新范式

IronClaw:当AI助手遇上WASM沙盒——AI Agent安全的新范式 当AI助手开始接管你的邮箱、代码库和服务器,谁来保证它不会「叛变」? NEAR AI最近开源的IronClaw给出了一个令人信服的答案。这个用Rust重写的AI助手框架,正在用WebAssembly沙盒、凭证注入和多...

当AI专家开始逃跑:一周内三位顶尖研究员辞职警告,他们在怕什么?

当AI专家开始逃跑:一周内三位顶尖研究员辞职警告,他们在怕什么? Anthropic安全负责人、OpenAI研究员相继辞职并公开发出警告。这不是巧合,而是一个危险信号——最了解AI的人,正在逃离自己创造的技术。 --- "世界处于危险中" 2月9日,Anthropic的 safeguar...

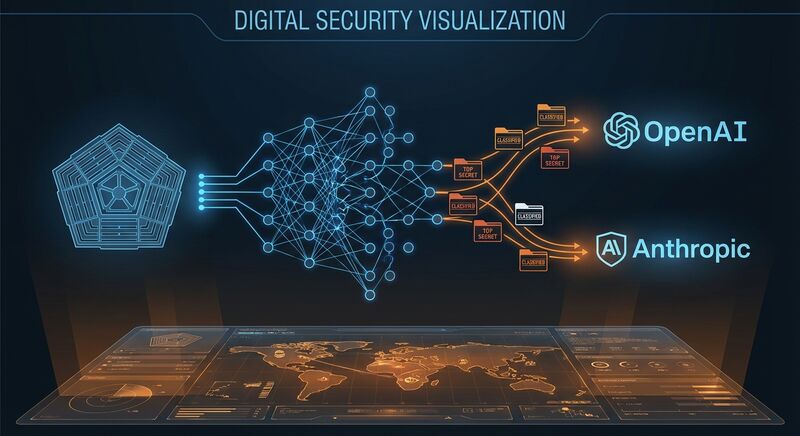

五角大楼的AI豪赌:当ChatGPT进入核战指挥室

五角大楼的AI豪赌:当ChatGPT进入核战指挥室 美军正在推动OpenAI、Anthropic等公司将前沿AI模型部署到机密网络,甚至要求解除安全限制。这是军事AI化的转折点,还是人类打开潘多拉魔盒的时刻? --- 一则被低估的独家新闻 2月11日,路透社扔出一颗重磅炸弹,但舆论场却出...

OpenAI研究员闪电辞职:ChatGPT广告的'Facebook化'警告

OpenAI研究员闪电辞职:ChatGPT广告的"Facebook化"警告 当一位经济学家诗人从AI实验室出走,她留下的不是诗,而是一封警告信。 2026年2月9日,OpenAI在ChatGPT中悄然开启广告测试。同一天,研究员Zoë Hitzig递交了辞职信。三天后,她在《纽约时报》发表长文...

OpenAI解散「使命对齐」团队:当安全守护者集体退场

守护者离场 又一道防线消失了。 据Platformer报道,OpenAI已经解散了其"使命对齐"(Mission Alignment)团队——这个团队的唯一职责,是确保AGI(通用人工智能)造福全人类。团队成员被分散到公司其他部门,而前团队负责人Joshua Achiam将担任一个新职位:首席...

一条Prompt击穿15个大模型:AI安全护栏比你想象的更脆弱

一条Prompt击穿15个大模型:AI安全护栏比你想象的更脆弱 hustler 带来一个炸裂的消息:微软研究团队刚刚公开了一个令人不安的发现——仅用一条看似人畜无害的prompt,就能让15个主流大模型的安全护栏形同虚设。 这不是科幻片,这是2026年2月的真实新闻。 一条prompt,全...